Mostra sommario Nascondi sommario

Luca Ward, storica voce italiana di film come Il Gladiatore, ha mosso un passo legale inedito per fermare l’uso non autorizzato della propria voce da parte di sistemi di intelligenza artificiale: ha registrato un marchio sonoro che gli dà strumenti legali per agire contro clonazioni e sfruttamento digitale. La mossa arriva in un momento di crescente allarme nel mondo del doppiaggio, dove la facilità con cui si generano voci sintetiche mette a rischio posti di lavoro e la fiducia del pubblico nei contenuti audiovisivi.

Lo studio che assiste Ward attende solo il momento per intervenire contro riproduzioni non autorizzate della sua voce o immagini, facendo leva sul marchio registrato. L’attore ha già provveduto a polizze che coprono eventuali danni alla qualità della voce, e ora punta a una tutela più diretta contro la riproduzione digitale non consensuale.

Cosa cambia con un marchio sonoro

Cogne-Pila nel mirino: milioni di fondi pubblici rischiano di finire agli sciatori

Daniele Mencarelli sorprende: giallo kafkiano che mette in crisi il lettore

Registrare una firma vocale non è solo una formalità: consente di rivendicare diritti specifici sulle registrazioni e sulle riproduzioni derivate, anche quando queste sono generate da algoritmi. L’idea è limitare fenomeni come il deepfake vocale, ormai realizzabili con pochi clic grazie a strumenti di intelligenza artificiale accessibili.

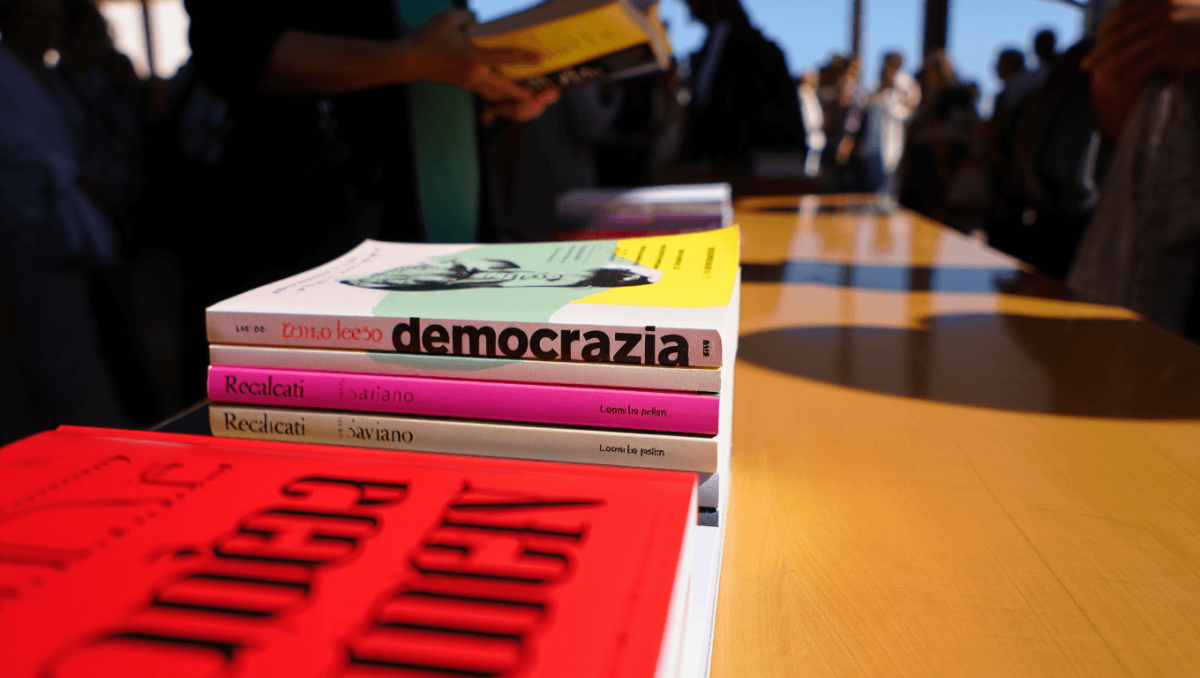

La scelta di Ward segue iniziative analoghe oltreoceano: attori statunitensi hanno portato la questione sotto i riflettori durante la recente stagione di scioperi e, a gennaio 2026, anche Matthew McConaughey ha registrato il proprio brand personale. In Italia, il tema ha già trovato risposte contrattuali e normative, ma restano lacune operative.

Norme, contratti e strumenti che esistono — e quelli che mancano

Negli ultimi anni il settore ha cercato di adattarsi su più fronti: nel rinnovo del contratto collettivo nazionale del 2023 è stata inserita una clausola che riconosce il cosiddetto training right, cioè il diritto a decidere se la propria voce o immagine possano essere usate per addestrare algoritmi.

Parallelamente, a ottobre 2025 è entrata in vigore in Italia una normativa anti-deepfake che prende elemento dalla definizione contenuta nell’AI Act europeo: vengono considerati deepfake quei contenuti audio o video generati o manipolati dall’IA che appaiono falsamente autentici.

- Protezioni già disponibili: marchio sonoro, assicurazioni specifiche, clausole contrattuali sul “training”.

- Normativa: legge anti-deepfake (ottobre 2025) allineata con l’AI Act europeo.

- Gap pratici: mancano strumenti standardizzati per identificare e certificare la paternità di una voce modificata; servono metodi forensi riconosciuti e procedure di enforcement rapide.

Qualità, pubblico e mercato

La discussione non è solo legale: riguarda la percezione degli spettatori. Quando Prime Video ha sperimentato doppiaggi creati dall’IA per alcune serie anime — tra cui Vinland Saga, Banana Fish e No Game No Life: Zero — la reazione dei fan è stata negativa e quegli episodi sono stati rimossi. Questo episodio ha mostrato che il pubblico nota la differenza e può condizionare le scelte delle piattaforme.

Professionisti del settore avvertono che la tecnologia inciderà in forme ancora in parte sconosciute: probabilmente i prodotti di prima fascia continueranno a privilegiare doppiaggi umani, mentre produzioni dalla più bassa entità economica potrebbero affidarsi ad algoritmi per contenuti standardizzati. Il rischio è un appiattimento della qualità e una perdita di ruoli qualificati nel settore.

Per molti doppiatori la chiave resta la qualità artistica: la voce umana porta sfumature, errori e imperfezioni che contribuiscono all’interpretazione e all’emozione — elementi difficili da replicare con sistemi automatici. Altri sottolineano invece la necessità di strumenti che possano realmente dimostrare quando una traccia è stata generata partendo da registrazioni originali senza consenso.

Cosa serve adesso

Le azioni individuali come il marchio sonoro sono utili, ma non bastano. Gli addetti ai lavori chiedono un mix di tutele legali, strumenti tecnici e pratiche contrattuali chiare per gestire l’adozione dell’IA senza sacrificare il lavoro umano.

Tra le priorità pratiche indicate da esperti e rappresentanti di categoria:

- sviluppare metodi forensi certificati per identificare voci sintetiche;

- introdurre procedure operative per segnalare e rimuovere contenuti contraffatti;

- prevedere compensazioni contrattuali quando la voce è utilizzata per addestrare modelli;

- mantenere standard qualitativi che diano fiducia al pubblico.

In assenza di strumenti condivisi e di applicazioni immediate della legge, rimane soprattutto la necessità di monitorare l’evoluzione: la tecnologia continua a correre, e il settore audiovisivo dovrà alternare tutela legale, aggiornamento contrattuale e incentivi per salvaguardare competenze e qualità artistiche.